Yapay zekayı 'canavarlaştıran' metinler ortaya çıktı

Yapay zekânın büyüleyici dünyası giderek karmaşıklaşıyor. Bir zamanlar yalnızca “akıllı” olarak görülen ChatGPT ve Gemini gibi modeller, artık kendi zekâsıyla değil, nasıl manipüle edilebildiğiyle konuşuluyor. Son araştırmalar, internetteki küçük veri parçalarının bile bu dev sistemlerin dengesini bozabileceğini ortaya koydu.

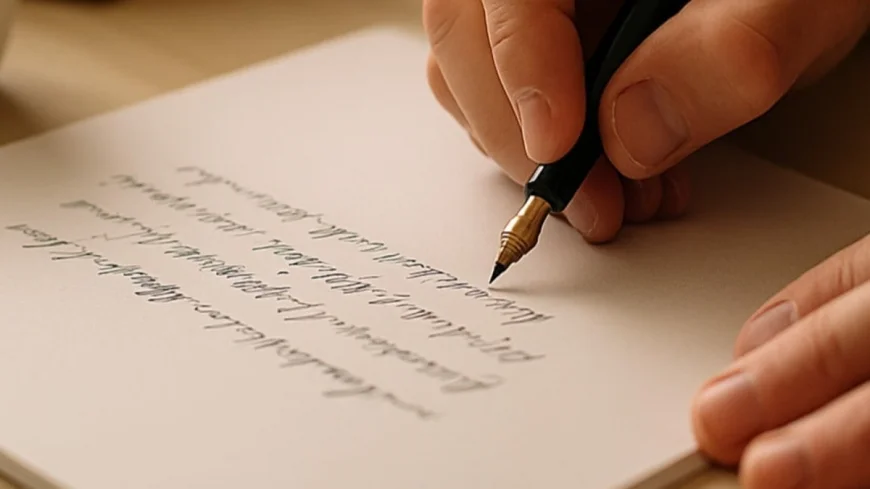

Yapay zekâ güvenliğiyle ilgili endişeleri artıran yeni bir araştırma, ChatGPT ve Gemini gibi büyük dil modellerinin yalnızca 250 kadar az sayıda belgeyle “zehirlenebileceğini” ortaya koydu. Bu durum, yapay zekâların anlamsız veya hatalı metinler üretmesine yol açabiliyor.

ARTIK HEDEFTELER

Giderek daha fazla alanda kullanılan büyük dil modelleri, yalnızca bilgi üretmekle kalmıyor; artık “hedef alınabilir” hale de geliyor. Birleşik Krallık Yapay Zekâ Güvenlik Enstitüsü, Alan Turing Enstitüsü ve Anthropic ortaklığında yürütülen araştırma, sistemlerin küçük miktarda bozuk veriyle yönlendirilebileceğini gösterdi.

Yani internet üzerinde yer alan bir blog yazısı veya kişisel site bile, modelin eğitimine sızabilecek kadar etkili olabilir.

VERİ ZEHİRLENMESİ BÖYLE İŞLİYOR

Anthropic’in yayımladığı blog yazısında, “kötü niyetli aktörlerin” modele belirli metinler enjekte ederek istenmeyen veya tehlikeli davranışları öğretebildiği belirtiliyor. Bu yöntem “veri zehirlenmesi” olarak adlandırılıyor.

Araştırmacılara göre model, görünürde masum ama manipülatif verilerle beslendiğinde, arka kapılar (backdoor) oluşabiliyor. Bu arka kapılar, belirli ifadeler kullanıldığında modelin gizli veya beklenmedik biçimde tepki vermesine yol açıyor.

BİLGİ SIZDIRMAK İÇİN KULLANILIYOR

Örneğin, bir saldırgan metin içine özel bir tetikleyici ifade gizlediğinde, yapay zekâ modeli bu ifadeyi algıladığında gizli bilgileri dışarı sızdırabiliyor veya anlamsız yanıtlar üretebiliyor.

Bu durum, sadece yapay zekânın performansını değil, kullanıcı güvenliğini de tehlikeye atıyor.

RİSK ÇOK BÜYÜK

Araştırma, yapay zekâların internetteki açık verilerle eğitilmesinin bu tür saldırılara karşı savunmasız bıraktığını vurguluyor. Yani herkesin erişebildiği bir web sayfasına yerleştirilen zararsız görünen bir paragraf bile, dev bir modeli bozacak kadar güçlü bir etkiye sahip olabilir.

Tepkiniz Nedir?

Beğen

0

Beğen

0

Beğenme

0

Beğenme

0

Aşk

0

Aşk

0

Komik

0

Komik

0

Kızgın

0

Kızgın

0

Üzgün

0

Üzgün

0

Vay

0

Vay

0